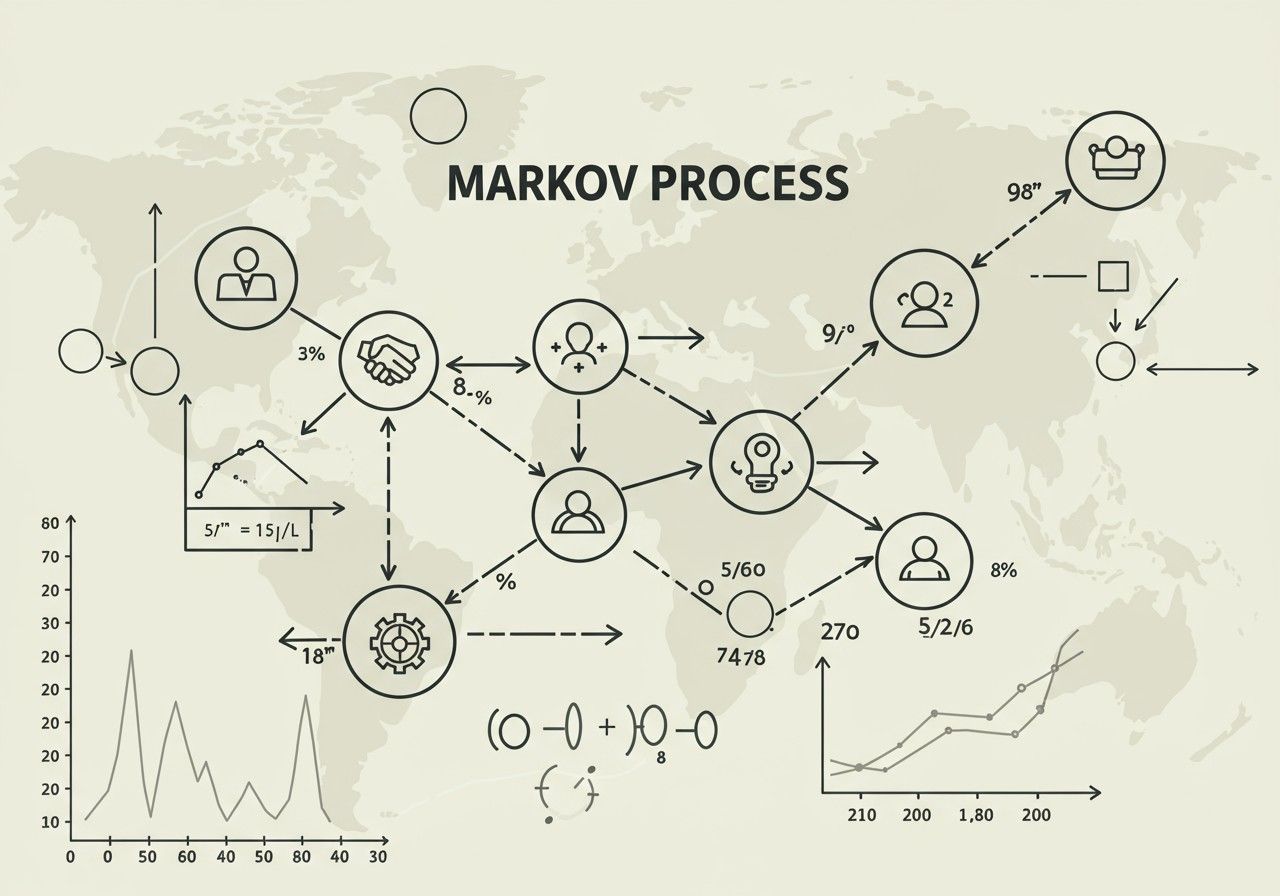

A modern tudomány és technológia számtalan területén találkozunk olyan jelenségekkel, ahol a jövőbeli állapot nem kizárólagosan a teljes múltbéli eseménysorozattól függ, hanem csupán az aktuális, jelenlegi helyzettől. Ez a látszólag egyszerű, mégis mélyreható elv képezi a Markov-folyamatok alapját, amelyek a valószínűségszámítás és a sztochasztikus folyamatok egyik legfontosabb és legszélesebb körben alkalmazott ágát képviselik. Az Andrey Markov orosz matematikus által a 20. század elején bevezetett koncepció forradalmasította a dinamikus rendszerek modellezését, és mára nélkülözhetetlenné vált a legkülönfélébb diszciplínákban, az informatikától a biológiáig, a közgazdaságtantól a mesterséges intelligenciáig.

A Markov-folyamat lényegét a „memóriamentesség” vagy Markov-tulajdonság adja: egy rendszer jövőbeli viselkedése – adott jelenlegi állapot mellett – független attól, hogyan jutott el ebbe az állapotba. Más szóval, a múltbeli események hatása teljesen beépül a jelenlegi állapotba, és a további predikciókhoz már nincs szükség a korábbi adatokra. Ez a tulajdonság rendkívül leegyszerűsíti a komplex rendszerek modellezését, lehetővé téve, hogy a végtelenül hosszú múlt helyett csupán a legutóbbi információkra koncentráljunk.

Ahhoz, hogy megértsük a Markov-folyamatok mélységét és jelentőségét, érdemes először a matematikai alapjait és a mögötte rejlő logikát feltárni. Kezdjük a fogalmak tisztázásával, majd haladjunk a különböző típusok és tulajdonságok felé, hogy végül bemutathassuk a számtalan gyakorlati alkalmazást, amelyek mindennapjaink szerves részévé váltak.

A Markov-tulajdonság és a memóriamentesség elve

A Markov-folyamatok alapvető definíciója a Markov-tulajdonságon nyugszik. Ez azt mondja ki, hogy egy sztochasztikus folyamatban a jövőbeli állapot valószínűségi eloszlása, a jelenlegi állapot ismeretében, független a múltbeli állapotoktól. Matematikailag ez a következőképpen fejezhető ki:

P(Xn+1 = j | Xn = i, Xn-1 = in-1, …, X0 = i0) = P(Xn+1 = j | Xn = i)

Ahol Xt a rendszer állapota a t időpillanatban, i és j pedig lehetséges állapotokat jelöl. Ez a formula azt jelenti, hogy a következő állapotba (j) való átmenet valószínűsége, feltéve, hogy a jelenlegi állapot i, nem változik, ha ismerjük a korábbi állapotokat is. A rendszer „nem emlékszik” a múltra, csak a jelenre fókuszál.

Ez a „memóriamentes” tulajdonság teszi a Markov-folyamatokat különösen alkalmassá olyan rendszerek modellezésére, ahol a rendszer belső mechanizmusai vagy a környezeti hatások miatt a múltbeli események hatása gyorsan elenyészik, vagy teljes mértékben beépül a jelenlegi állapotba. Gondoljunk például egy pénzérme feldobására: az, hogy legutóbb fej vagy írás volt, semmilyen módon nem befolyásolja a következő dobás kimenetelének valószínűségét.

Bár a pénzérme egyszerű példa, a valós rendszerekben is sokszor megfigyelhető ez a viselkedés, legalábbis megfelelő absztrakciós szinten. Például egy időjárás-előrejelző modellben a holnapi időjárás valószínűsége nagymértékben függ a mai időjárástól, de kevésbé a tegnapitól vagy az azelőttitől. Természetesen ez egy egyszerűsítés, de a Markov-modellek ereje éppen abban rejlik, hogy képesek kezelni ezeket az egyszerűsítéseket, miközben mégis hasznos predikciókat adnak.

A memóriamentesség elve nem azt jelenti, hogy a múlt egyáltalán nem számít, hanem azt, hogy a releváns információ a jelenlegi állapotba sűrűsödik. Ez a tulajdonság teszi lehetővé a Markov-láncok matematikai kezelhetőségét és alkalmazhatóságát számos komplex problémában, ahol a teljes történet nyomon követése túl bonyolult vagy lehetetlen lenne.

A sztochasztikus folyamatok és a Markov-láncok eredete

Mielőtt mélyebbre ásnánk a Markov-folyamatok részleteiben, érdemes röviden áttekinteni a tágabb kontextust, amelybe illeszkednek: a sztochasztikus folyamatokat. A sztochasztikus folyamat lényegében egy időben fejlődő véletlen jelenségek sorozata, vagyis olyan változók gyűjteménye, amelyeknek értéke idővel változik, és amelyek viselkedését a valószínűség törvényei irányítják. Gondoljunk például a tőzsdei árfolyamok ingadozására, a részecskék Brown-mozgására, vagy akár az ügyfelek sorbanállására egy bankban.

Ezen a tágabb kategórián belül a Markov-lánc egy speciális típusú sztochasztikus folyamat, amely diszkrét állapotokkal és diszkrét idővel rendelkezik. Ez azt jelenti, hogy a rendszer csak bizonyos, jól elkülöníthető állapotokban lehet (pl. „esős”, „napos”, „felhős” időjárás), és az állapotváltozások csak meghatározott időpillanatokban történnek (pl. minden nap végén). Léteznek azonban folytonos idejű Markov-folyamatok is, amelyekről később részletesebben is szó lesz.

A Markov-folyamatok elméletét Andrey Andreyevich Markov (1856–1922) orosz matematikus fejlesztette ki a 20. század elején. Eredeti motivációja a nyelvészetben és a statisztikai mechanikában felmerülő problémák megoldása volt, különösen a betűsorozatok statisztikai elemzése orosz szövegekben. Markov felfedezte, hogy bizonyos feltételezésekkel leegyszerűsíthető az egymást követő események közötti függőség modellezése.

Markov eredetileg a magánhangzók és mássalhangzók előfordulásának mintázatait vizsgálta Puskin „Jevgenyij Anyegin” című művében, felismerve, hogy egy adott betű valószínűsége nagymértékben függ az előző betűtől, de kevésbé a korábbiaktól.

Ez a felismerés, miszerint a jövő csak a jelenen keresztül függ a múlttól, áttörést jelentett a komplex rendszerek modellezésében. A kezdeti nyelvtudományi és statisztikai alkalmazásokon túl a Markov-láncok gyorsan elterjedtek más tudományágakban is, és alapvető eszközzé váltak a véletlen folyamatok elemzésében. A modern kor számítógépes teljesítménye pedig lehetővé tette a bonyolultabb Markov-modellek szimulációját és elemzését is, tovább növelve azok jelentőségét.

A Markov-láncok matematikai alapjai

A Markov-láncok megértéséhez elengedhetetlen néhány alapvető matematikai fogalom tisztázása. Ezek az elemek alkotják a modell építőköveit, és lehetővé teszik a rendszer viselkedésének kvantitatív leírását és előrejelzését.

Állapotok és állapottér

Egy Markov-lánc rendszere különböző állapotokban létezhet. Ezek az állapotok lehetnek diszkrétek és véges számúak (pl. „napos”, „esős”, „felhős” időjárás), vagy akár végtelen számúak (pl. a sorban állók száma egy végtelen kapacitású sorban). A lehetséges állapotok összességét nevezzük állapottérnek (state space).

Fontos, hogy az állapotok egyértelműen definiálva legyenek, és a rendszer mindig pontosan egy állapotban tartózkodjon egy adott időpillanatban. Az állapotok definíciója alapvető fontosságú a modell sikerességéhez, hiszen ez határozza meg, milyen részletességgel tudjuk leírni a rendszer viselkedését.

Átmeneti valószínűségek és az átmeneti mátrix

A Markov-lánc dinamikáját az átmeneti valószínűségek írják le. Ezek a valószínűségek azt fejezik ki, hogy egy adott állapotból egy másik állapotba mennyi eséllyel jut el a rendszer egy időlépés alatt. Ha a rendszer jelenleg az i állapotban van, akkor P(Xn+1 = j | Xn = i) jelöli annak valószínűségét, hogy a következő időlépésben a j állapotba kerül.

Ezeket az átmeneti valószínűségeket gyakran egy átmeneti mátrixba (transition matrix) rendezzük, amelyet P-vel jelölünk. Egy N állapotú rendszer esetén ez egy N x N-es mátrix, ahol a Pij elem az i állapotból a j állapotba való átmenet valószínűségét adja meg.

Az átmeneti mátrixnak van néhány alapvető tulajdonsága:

- Minden Pij elemnek 0 és 1 között kell lennie (valószínűség).

- Minden sorösszegnek 1-nek kell lennie, mivel az i állapotból a rendszernek mindenképpen valamilyen állapotba kell átmennie (beleértve az i állapotban maradást is).

Például, ha van egy időjárás modellünk két állapottal: „Napos” (1) és „Esős” (2), az átmeneti mátrix így nézhet ki:

| Napos (1) | Esős (2) | |

|---|---|---|

| Naposból (1) | 0.8 | 0.2 |

| Esősből (2) | 0.4 | 0.6 |

Ez a mátrix azt jelenti, hogy ha ma napos az idő, 80% eséllyel holnap is napos lesz, és 20% eséllyel esős. Ha ma esős az idő, 40% eséllyel holnap napos lesz, és 60% eséllyel esős.

Homogén és inhomogén láncok

A legtöbb Markov-lánc, amellyel találkozunk, homogén. Ez azt jelenti, hogy az átmeneti valószínűségek időben állandóak, vagyis az átmeneti mátrix nem változik az idő múlásával. A fenti időjárás-példa egy homogén lánc.

Ezzel szemben az inhomogén Markov-láncokban az átmeneti valószínűségek függenek az időtől, tehát az átmeneti mátrix időről időre változhat. Ezek modellezése bonyolultabb, de bizonyos valós helyzetekben (pl. szezonális változásokkal járó rendszerek) elengedhetetlen.

Az állapotvektor és a Chapman-Kolmogorov egyenlet

Egy adott időpillanatban a rendszer valószínűségi eloszlását az állapotok felett egy állapotvektor írja le. Ez egy sorvektor, amelynek πt elemei megadják annak valószínűségét, hogy a rendszer a t időpillanatban az egyes állapotokban tartózkodik. Ha π0 a kezdeti állapoteloszlás (azaz tudjuk, melyik állapotban volt a rendszer kezdetben, vagy milyen valószínűséggel), akkor a következő időpillanatban lévő eloszlás a következőképpen számítható:

π1 = π0P

Általánosságban, a k lépés utáni állapoteloszlás a πk = π0Pk képlettel adható meg. Itt jön képbe a Chapman-Kolmogorov egyenlet, amely azt mondja ki, hogy a több lépéses átmeneti valószínűségek a mátrixhatványozással számíthatók. Az i állapotból j állapotba való átmenet valószínűsége k lépés alatt a Pk mátrix (i,j) eleme.

Ez az egyenlet rendkívül fontos, mert lehetővé teszi, hogy a rendszer hosszú távú viselkedését előrejelezzük, pusztán a rövid távú átmeneti valószínűségek ismeretében. A Chapman-Kolmogorov egyenlet tehát a Markov-folyamatok prediktív erejének kulcsa.

A Markov-láncok típusai és tulajdonságai

A Markov-folyamatok sokfélesége miatt számos osztályozási szempont létezik, amelyek segítenek megérteni a különböző típusok viselkedését és alkalmazhatóságát. A legfontosabb megkülönböztetések az idő és az állapotok jellege, valamint a lánc hosszú távú viselkedése alapján történnek.

Diszkrét idejű és folytonos idejű Markov-láncok

Ahogy már említettük, a diszkrét idejű Markov-láncok (DIMC) esetében az állapotváltozások csak meghatározott, diszkrét időpillanatokban történnek (pl. minden nap, óra, vagy tranzakció után). Ez a leggyakrabban tárgyalt és alkalmazott típus.

Ezzel szemben a folytonos idejű Markov-láncok (CTMC) esetében az állapotváltozások bármely időpontban bekövetkezhetnek. Itt nem átmeneti valószínűségekről beszélünk egy adott időlépésre, hanem átmeneti rátákról (transition rates), amelyek azt fejezik ki, milyen intenzitással történik az átmenet egyik állapotból a másikba. A CTMC-ket például sorbanállási rendszerek, radioaktív bomlás vagy biológiai folyamatok modellezésére használják, ahol az események nem fix időközönként zajlanak.

Véges és végtelen állapotterű láncok

Egy Markov-lánc lehet véges állapotterű, ha a lehetséges állapotok száma korlátos (pl. az időjárás három állapota). Ezek a láncok matematikailag általában könnyebben kezelhetők.

Ezzel szemben a végtelen állapotterű láncok esetén a lehetséges állapotok száma végtelen (pl. a sorban állók száma egy végtelen kapacitású sorban, vagy egy populáció mérete). Ezek elemzése gyakran bonyolultabb matematikai eszközöket igényel, de számos valós jelenséget csak így lehet pontosan modellezni.

Állapotosztályok és kommunikáló állapotok

Egy Markov-lánc állapotai között különböző kapcsolatok állhatnak fenn. Két állapot, i és j, akkor kommunikál, ha i-ből el lehet jutni j-be, és j-ből is el lehet jutni i-be (akár több lépésben is). Ha minden állapot minden más állapottal kommunikál, akkor a láncot irreducibilisnek nevezzük. Ez a tulajdonság alapvető a hosszú távú viselkedés szempontjából.

Az állapotok csoportosíthatók állapotosztályokba:

- Tranziens (átmeneti) állapotok: Olyan állapotok, ahonnan a rendszer elhagyása után soha többé nem tér vissza.

- Rekurrens (visszatérő) állapotok: Olyan állapotok, ahonnan, ha a rendszer elhagyja őket, végtelen sokszor visszatér oda.

- Abszorbeáló (elnyelő) állapotok: Speciális rekurrens állapotok, ahonnan nem lehet más állapotba átmenni. Ha a rendszer egyszer belép egy abszorbeáló állapotba, ott is marad.

Periodicitás és aperiodicitás

Egy állapot periódusa az a legnagyobb közös osztója azoknak a lépésszámoknak, amelyek alatt a rendszer az adott állapotból visszatérhet önmagába. Ha egy állapot periódusa 1, akkor aperiodikusnak nevezzük. Ha minden állapot aperiodikus egy irreducibilis láncban, akkor az egész lánc aperiodikus.

Az aperiodicitás fontos feltétel a stacionárius eloszlás létezéséhez és egyediségéhez.

Stacionárius eloszlás (egyensúlyi eloszlás)

A stacionárius eloszlás (más néven egyensúlyi eloszlás vagy invariáns eloszlás) a Markov-láncok egyik legfontosabb tulajdonsága. Ez egy olyan valószínűségi eloszlás az állapotok felett, amely időben stabil. Ha a rendszer elérte ezt az eloszlást, akkor az átmeneti mátrix alkalmazása után is ugyanaz az eloszlás marad fenn.

Matematikailag a stacionárius eloszlás (π) kielégíti a π = πP egyenletet, ahol P az átmeneti mátrix.

Egy irreducibilis és aperiodikus, véges állapotterű Markov-lánc esetén garantáltan létezik egy egyedi stacionárius eloszlás. Ez azt jelenti, hogy elegendő számú lépés után a rendszer állapoteloszlása függetlenné válik a kezdeti állapotától, és konvergál ehhez a stacionárius eloszláshoz. Ez az eloszlás adja meg az egyes állapotokban való hosszú távú tartózkodás valószínűségét.

A stacionárius eloszlás rendkívül hasznos a hosszú távú viselkedés elemzésében, például egy rendszer átlagos kihasználtságának vagy egy adott állapotban való tartózkodás arányának meghatározásában. Például egy sorbanállási rendszerben ez adhatja meg az átlagos sorhosszúságot vagy a rendszer kihasználtságát hosszú távon.

Ergódikus láncok

Egy Markov-lánc akkor ergódikus, ha irreducibilis és aperiodikus. Az ergódikus láncok rendelkeznek egyedi stacionárius eloszlással, és a rendszer állapoteloszlása konvergál ehhez az eloszláshoz, függetlenül a kezdeti állapottól. Ez a tulajdonság alapvető fontosságú számos alkalmazásban, mivel lehetővé teszi a hosszú távú előrejelzéseket és a rendszer stabil viselkedésének elemzését.

A Markov-folyamatok jelentősége és alkalmazási területei

A Markov-folyamatok elméleti eleganciája és a memóriamentesség elvének egyszerűsége ellenére rendkívül sokoldalú eszközökké váltak. Számos tudományágban és ipari szektorban alkalmazzák őket komplex rendszerek modellezésére, elemzésére és optimalizálására. A lista szinte végtelen, de tekintsünk át néhány kiemelkedő példát.

Közgazdaságtan és pénzügy

A pénzügyi piacok dinamikus és véletlenszerű természete ideális terepet biztosít a Markov-modellek alkalmazására. Bár a valós tőzsdei árfolyamok mozgása ennél jóval összetettebb, egyszerűsített Markov-modellekkel mégis lehet közelítő előrejelzéseket készíteni, vagy legalábbis megérteni a piaci viselkedés bizonyos aspektusait.

- Hitelkockázat modellezése: A Markov-láncokat arra használják, hogy modellezzék egy vállalat vagy egy hitelfelvevő hitelképességének változását az idő múlásával. Az állapotok lehetnek például „AAA”, „BBB”, „BB”, „CCC” (befektetési kategóriák) vagy „nemfizető”. Az átmeneti valószínűségek azt mutatják meg, hogy egy vállalat milyen eséllyel romlik vagy javul a hitelképessége egy adott időszak alatt.

- Ügyfélvándorlás (churn) modellezése: A telekommunikációs, banki vagy kiskereskedelmi szektorban a Markov-láncokkal modellezik az ügyfelek állapotváltozását (pl. „aktív”, „inaktív”, „lemondta”, „átváltott versenytársra”). Ez segíti a vállalatokat az ügyfélmegtartási stratégiák kidolgozásában.

- Tőzsdei árfolyamok egyszerűsített modellezése: Bár a hatékony piac hipotézise szerint a jövőbeli árfolyamok nem prediktálhatók a múltbeli adatokból, bizonyos modellek (pl. GARCH modellek) tartalmaznak Markov-szerű elemeket, vagy diszkrét állapotú modellekkel próbálják megragadni a volatilitás változását.

- Portfólió optimalizálás: A befektetési portfóliók teljesítményének modellezésére is használhatók, figyelembe véve a különböző eszközök közötti átmeneti valószínűségeket.

Biológia és orvostudomány

A biológiai rendszerek, a molekuláris folyamatoktól a populációk dinamikájáig, gyakran mutatnak Markov-szerű viselkedést, ami termékeny talajt biztosít az elmélet alkalmazásának.

- Genetika és DNS-szekvenciák elemzése: A Markov-láncok alapvető eszközei a DNS-szekvenciák mintázatainak elemzésében. A bázisok (A, T, C, G) egymásutániságának valószínűsége gyakran függ az előző bázistól. A rejtett Markov-modelleket (HMM) különösen széles körben alkalmazzák génkeresésre, protein domén azonosításra és filogenetikai elemzésekre.

- Járványtan: A fertőző betegségek terjedésének modellezésére is használhatók, ahol az állapotok lehetnek „fogékony”, „fertőzött”, „gyógyult”, „immunis”. Az átmeneti valószínűségek a fertőzési és gyógyulási rátáktól függenek. Az SIR (Susceptible-Infected-Recovered) modellek is gyakran épülnek Markov-folyamatokra.

- Gyógyszerészeti kutatás és klinikai vizsgálatok: A gyógyszerek hatékonyságának és a betegségek progressziójának modellezésére, ahol az állapotok a betegség különböző stádiumai vagy a kezelésre adott válaszok.

- Populációdinamika: Fajok populációjának növekedését, csökkenését vagy kihalását modellezhetik, figyelembe véve a születési, halálozási és migrációs rátákat.

Informatika és számítástechnika

Az informatika talán az egyik leginkább áthatott terület a Markov-modellek által, a mesterséges intelligenciától a hálózati protokollokig.

Google PageRank algoritmus

A PageRank a Google keresőmotorjának egyik eredeti és legfontosabb algoritmusa, amely a weboldalak fontosságát rangsorolja. Ez egy klasszikus példa a Markov-láncok alkalmazására. A webet egy gráfként képzeljük el, ahol az oldalak a csúcsok, a linkek pedig az élek. Egy „véletlen szörföző” Markov-láncot alkot, ahol az állapotok a weboldalak, az átmeneti valószínűségek pedig a linkek követésének valószínűségét jelentik. A PageRank érték lényegében a Markov-lánc stacionárius eloszlása, amely megadja annak valószínűségét, hogy egy hosszú idő után a véletlen szörföző melyik oldalon tartózkodik. Minél nagyobb egy oldal PageRank-je, annál valószínűbb, hogy a véletlen szörföző oda jut, és annál fontosabbnak ítéli meg a Google.

A PageRank algoritmus egy elegáns alkalmazása a Markov-láncok stacionárius eloszlásának, amely forradalmasította a webes keresést azáltal, hogy számszerűsítette a weboldalak „fontosságát” a linkstruktúra alapján.

Természetes nyelvi feldolgozás (NLP)

Az NLP területén a Markov-modellek kulcsszerepet játszanak a szövegek elemzésében, generálásában és a beszédfelismerésben.

- Szöveggenerálás és prediktív szövegbevitel: A Markov-láncokkal modellezhető a szavak, betűk vagy szótagok egymásutániságának valószínűsége. Ez alapján lehet szövegeket generálni, vagy prediktív szövegbeviteli rendszereket (pl. okostelefonok billentyűzetei) fejleszteni, amelyek a felhasználó által begépelt előző szavak alapján javasolnak következő szavakat.

- Beszédfelismerés: A rejtett Markov-modellek (HMM) alapvetőek a modern beszédfelismerő rendszerekben. A HMM-ek képesek kezelni a megfigyelhető adatok (pl. hanghullámok) és a mögöttes, rejtett állapotok (pl. fonémák vagy szavak) közötti kapcsolatot.

- Gépi fordítás: Statisztikai gépi fordítási rendszerekben is alkalmazzák a szavak egymásutániságának modellezésére.

Hálózatok és sorbanállási elmélet

A hálózati forgalom, a telekommunikációs rendszerek és a számítógépes hálózatok viselkedését gyakran Markov-modellekkel elemzik.

- Sorbanállási elmélet (Queueing Theory): A Markov-láncok alapvetőek a sorbanállási rendszerek modellezésében, ahol az állapotok a sorban állók számát jelentik. Segítenek optimalizálni a szolgáltatások kapacitását, minimalizálni a várakozási időt, és megérteni a rendszer teljesítményét (pl. telefonközpontok, szerverfarmok, pénztárak).

- Csomagforgalom modellezése: Az internetes csomagok útvonalválasztásának és késésének elemzésére, a hálózati torlódások előrejelzésére.

- Megbízhatósági modellek: Rendszerek vagy alkatrészek meghibásodási és javítási folyamatainak modellezésére, az állapotok lehetnek „működőképes”, „részben működőképes”, „meghibásodott”.

Adatkompresszió

A Markov-modellek segítenek az adatok tömörítésében azáltal, hogy kihasználják az adatokban lévő mintázatokat és redundanciákat. Például egy adott karakter valószínűsége függhet az előző karaktertől, és ez az információ felhasználható a hatékonyabb kódoláshoz.

Mérnöki tudományok

A mérnöki alkalmazások széles skáláján is megjelennek a Markov-folyamatok.

- Minőségellenőrzés: Gyártási folyamatok minőségének felügyeletére, ahol az állapotok a termék minőségi kategóriái (pl. „hibátlan”, „javítható”, „selejt”).

- Karbanhangolás és prediktív karbantartás: Berendezések állapotának monitorozására és a karbantartási igények előrejelzésére, minimalizálva a leállásokat és optimalizálva a költségeket.

- Robotika: Navigációs és mozgástervezési feladatokban, ahol a robot aktuális pozíciója és a környezet interakciói Markov-szerűen modellezhetők.

Társadalomtudományok

A társadalmi jelenségek komplexitása ellenére bizonyos aspektusok Markov-modellekkel is megközelíthetők.

- Szavazói magatartás modellezése: A választók pártpreferenciáinak változását modellezhetik, ahol az állapotok a különböző pártok. Az átmeneti valószínűségek a politikai események, kampányok hatásait tükrözik.

- Népességdinamika: A népesség korcsoportok vagy társadalmi osztályok közötti mozgásának modellezése.

- Mobilitás: A munkahelyi vagy lakóhelyi mobilitás elemzése, ahol az állapotok különböző régiók vagy foglalkozási kategóriák.

Játékok és szerencsejátékok

A Markov-láncok szórakoztató, de tanulságos alkalmazásai is léteznek.

- Kígyók és létrák játék: Ez a klasszikus társasjáték egy tökéletes példája egy Markov-láncnak, ahol a mezők az állapotok, a dobások pedig az átmenetek. A játék elemzése Markov-láncokkal lehetővé teszi a győzelmi valószínűségek és az átlagos játékidő kiszámítását.

- Rulett: Egyszerűsített modellekkel elemezhető a rulettjáték kimenetele és a különböző stratégiák hatékonysága, bár a kaszinó mindig nyer.

Környezettudomány

Az időjárás-modellezés már említésre került, de más környezeti folyamatok is modellezhetők.

- Környezetszennyezés terjedése: A szennyező anyagok terjedésének modellezése a levegőben vagy vízben, ahol az állapotok a szennyezés koncentrációja különböző területeken.

- Ökológiai rendszerek: Fajok közötti interakciók, ökoszisztémák állapotváltozásai.

A Markov-folyamatok előnyei és korlátai

Mint minden matematikai modell, a Markov-folyamatok is rendelkeznek sajátos erősségekkel és gyengeségekkel. Megértésük kulcsfontosságú a helyes alkalmazáshoz és az eredmények értelmezéséhez.

Előnyök

- Egyszerűség és matematikai kezelhetőség: A Markov-tulajdonság jelentősen leegyszerűsíti a komplex rendszerek modellezését. A jövő előrejelzéséhez elegendő a jelenlegi állapot ismerete, a teljes múltbeli történet helyett. Ez a matematikai levezetéseket is könnyebbé teszi.

- Prediktív erő: Képesek előrejelezni a rendszer jövőbeli viselkedését, mind rövid, mind hosszú távon (stacionárius eloszlás).

- Rugalmasság: Számos különböző rendszer modellezésére alkalmasak, diszkrét vagy folytonos idővel, véges vagy végtelen állapotokkal.

- Széles körű alkalmazhatóság: Ahogy a fentiek is mutatják, szinte minden tudományágban és iparágban megtalálják a helyüket.

- Vizualizálhatóság: Az állapotgráfok és átmeneti mátrixok jól vizualizálhatók, ami megkönnyíti a modell megértését és kommunikálását.

Korlátok

- A memóriamentesség feltételezése: Ez a legnagyobb korlát. Sok valós rendszer „memóriával” rendelkezik, azaz a jövőbeli viselkedés nem csak a jelenlegi állapottól, hanem a korábbi eseményektől is függ. Ha ez a feltételezés nem áll fenn, a Markov-modell pontatlan lehet.

- Állapotok definiálása: A megfelelő állapotok definiálása kulcsfontosságú, de gyakran nehéz feladat. Ha az állapotok túl durván vannak definiálva, elveszhetnek fontos információk. Ha túl finoman, az állapottér „robbanásszerűen” megnőhet, ami kezelhetetlenné teszi a modellt.

- Átmeneti valószínűségek becslése: A valós rendszerekben az átmeneti valószínűségeket adatokból kell becsülni. Ehhez elegendő mennyiségű és megbízható adat szükséges, ami nem mindig áll rendelkezésre. A pontatlan becslések pontatlan modellezést eredményeznek.

- Egyszerűsítések: A Markov-modellek természetszerűleg egyszerűsítik a valóságot. Ez egyben erősségük is, de a túlzott egyszerűsítés elveszítheti a rendszer lényeges aspektusait.

- Állapottér robbanás (state space explosion): Nagy és komplex rendszerek esetén az állapotok száma exponenciálisan növekedhet, ami rendkívül nehézzé teszi az átmeneti mátrix kezelését és a számításokat.

E korlátok ellenére a Markov-folyamatok továbbra is rendkívül értékes eszközök. Gyakran használják őket kiindulási pontként, amelyet aztán fejlettebb modellekkel (pl. Rejtett Markov-modellek, Markov döntési folyamatok) egészítenek ki, hogy jobban megragadják a valóság komplexitását.

Kiterjesztések és kapcsolódó koncepciók

A Markov-folyamatok alapvető elmélete számos kiterjesztést és kapcsolódó koncepciót inspirált, amelyek a „memóriamentesség” elvét különböző módon alkalmazzák vagy módosítják, hogy még szélesebb körű problémákra kínáljanak megoldást.

Rejtett Markov-modellek (HMM)

A Rejtett Markov-modellek (Hidden Markov Models, HMM) a Markov-láncok egy különösen fontos kiterjesztése, ahol a rendszer állapotai nem közvetlenül megfigyelhetők. Csak az állapotokhoz kapcsolódó, véletlenszerű megfigyelések (outputs) érhetők el. Például, ha egy időjárás modellben nem tudjuk közvetlenül a „napos” vagy „esős” állapotot, de látunk olyan megfigyeléseket, mint „sétáló emberek száma” vagy „esernyők száma”.

A HMM-ek három fő problémára adnak választ:

- Értékelés: Adott modell és megfigyeléssorozat esetén mennyi a megfigyelés valószínűsége? (Felhasználás: beszédfelismerésben annak valószínűsége, hogy egy hangsorozat egy adott szót jelent.)

- Dekódolás: Adott modell és megfigyeléssorozat esetén mi a legvalószínűbb mögöttes állapotsorozat? (Felhasználás: génkeresésben a DNS-szekvencia alapján a génszakaszok azonosítása.)

- Tanulás: Adott megfigyeléssorozat esetén hogyan becsülhetők a modell paraméterei (átmeneti és kibocsátási valószínűségek)? (Felhasználás: a modell „betanítása” adatok alapján.)

A HMM-ek alapvetőek a beszédfelismerésben, a bioinformatikában (génszekvenciák elemzése), a természetes nyelvi feldolgozásban (pl. szótagolás, morfológiai elemzés) és a jelfeldolgozásban.

Markov döntési folyamatok (MDP)

A Markov döntési folyamatok (Markov Decision Processes, MDP) a Markov-láncok egy olyan kiterjesztése, amely magában foglalja a döntéshozatalt és a jutalmakat. Itt a rendszer nem csak állapotok között vált, hanem egy külső ágens (döntéshozó) akciókat hajthat végre, amelyek befolyásolják az átmeneti valószínűségeket és jutalmakat generálnak. A cél az optimális stratégia megtalálása, azaz olyan akciósorozat kiválasztása, amely maximalizálja a várható hosszú távú jutalmat.

Az MDP-k alapvetőek a megerősítéses tanulásban (reinforcement learning), amely a mesterséges intelligencia egyik fő területe. Alkalmazzák őket robotikában, játékokban (pl. AlphaGo), erőforrás-gazdálkodásban és optimalizálási problémákban, ahol a rendszernek döntéseket kell hoznia bizonytalan környezetben.

Monte Carlo Markov-lánc (MCMC)

A Monte Carlo Markov-lánc (Monte Carlo Markov Chain, MCMC) módszerek egy osztályát képviselik, amelyek komplex valószínűségi eloszlásokból történő mintavételezésre szolgálnak, különösen akkor, ha az eloszlások analitikusan nehezen kezelhetők. Az MCMC alapötlete, hogy egy Markov-láncot építünk fel, amelynek stacionárius eloszlása megegyezik a kívánt valószínűségi eloszlással. A láncot futtatva és mintákat gyűjtve az állapotokból, közelítést kapunk az eloszlásra.

Az MCMC technikák, mint például a Metropolis-Hastings algoritmus vagy a Gibbs-mintavételezés, széles körben elterjedtek a Bayes-i statisztikában, a fizikában, a kémiai szimulációkban és a gépi tanulásban, ahol komplex, többdimenziós eloszlásokkal kell dolgozni.

Markov mezők és feltételes véletlen mezők (CRF)

A Markov mezők (Markov Random Fields, MRF) a Markov-folyamatok térbeli analógjai, ahol a véletlen változók közötti függőségek egy gráf struktúrájában vannak ábrázolva. A feltételes függetlenség itt a szomszédokra korlátozódik. A feltételes véletlen mezők (Conditional Random Fields, CRF) a Markov mezők egy speciális típusa, amelyet gyakran használnak a szekvenciális adatok címkézésére, például a természetes nyelvi feldolgozásban (pl. named entity recognition) és a számítógépes látásban.

Gyakorlati tanácsok a Markov-modellezéshez

A Markov-folyamatok elmélete egy dolog, de a valós problémákra való alkalmazásuk során számos gyakorlati szempontot figyelembe kell venni. Egy jól megtervezett és implementált Markov-modell jelentős betekintést nyújthat egy rendszer működésébe.

1. A probléma pontos definiálása

Mielőtt bármilyen modellt építenénk, elengedhetetlen a probléma alapos megértése. Milyen rendszert szeretnénk modellezni? Milyen kérdésekre keressük a választ? A Markov-tulajdonság vajon érvényesül a rendszerben, vagy legalábbis elfogadható közelítésnek tekinthető?

2. Állapotok megfelelő definiálása

Ez az egyik legkritikusabb lépés. Az állapotoknak:

- Kölcsönösen kizáróaknak kell lenniük: a rendszer egyszerre csak egy állapotban lehet.

- Teljesnek kell lenniük: az összes lehetséges helyzetet le kell fedniük.

- Relevánsnak kell lenniük: tükrözniük kell a rendszer azon aspektusait, amelyek fontosak a modell célja szempontjából.

Túl kevés állapot túl egyszerű modellt eredményez, ami elveszíti a lényeges információkat. Túl sok állapot pedig az állapottér robbanásához vezethet, ami kezelhetetlenné teszi a modellt. Gyakran iteratív folyamat az állapotok finomítása.

3. Átmeneti valószínűségek becslése

Az átmeneti valószínűségek meghatározása történhet:

- Empirikus adatok alapján: Ha rendelkezésre állnak múltbeli adatok a rendszer állapotváltozásairól, akkor egyszerűen megszámolhatjuk az átmeneteket és becsülhetjük a valószínűségeket. Minél több adat áll rendelkezésre, annál pontosabb lesz a becslés.

- Szakértői becslés alapján: Ha nincsenek adatok, szakértők véleményére támaszkodhatunk. Ez különösen hasznos új rendszerek vagy ritka események modellezésénél.

- Elméleti megfontolások alapján: Bizonyos esetekben (pl. fizikai vagy kémiai folyamatok) az átmeneti valószínűségeket elméleti modellekből vagy alapvető törvényekből is levezethetjük.

Fontos a becslések validálása, és a modell érzékenységének vizsgálata a valószínűségek változásaira.

4. A modell validálása és tesztelése

Miután felépítettük a modellt, alapvető fontosságú a validálása. Ez magában foglalhatja:

- A modell kimeneteinek összehasonlítása valós adatokkal: A predikciók mennyire pontosak?

- Érzékenységvizsgálat: Hogyan változnak a modell eredményei, ha az átmeneti valószínűségek vagy a kezdeti állapotok kissé eltérnek?

- Szimulációk futtatása: Különösen komplex rendszerek esetén a szimuláció segíthet megérteni a modell viselkedését és azonosítani a hibákat.

5. Az eredmények értelmezése és kommunikálása

Egy matematikai modell csak akkor hasznos, ha az eredményeit érthető módon tudjuk értelmezni és kommunikálni a döntéshozók felé. A stacionárius eloszlás, az átlagos tartózkodási idők, az abszorbeáló állapotokba való jutás valószínűségei mind releváns mutatók lehetnek.

6. Szoftveres eszközök használata

Számos szoftveres eszköz és könyvtár létezik a Markov-láncok modellezésére és elemzésére. Néhány példa:

- Python: A

scipy.linalgmodul mátrixműveletekhez, anumpyéspandasadatok kezeléséhez. Vannak speciális könyvtárak is, mint például ahmmlearnHMM-ekhez. - R: Számos csomag létezik statisztikai modellezéshez, beleértve a Markov-láncokat is.

- MATLAB: Erős mátrixkezelési képességei miatt népszerű a mérnöki és tudományos alkalmazásokban.

Ezen gyakorlati tanácsok betartásával a Markov-folyamatok hatékony eszközökké válhatnak a legkülönfélébb problémák megoldásában, segítve a rendszerek megértését, a jövőbeli viselkedés előrejelzését és az optimális döntések meghozatalát.

A Markov-folyamatok, az Andrey Markov által bevezetett memóriamentes elvvel, az elmúlt évszázad egyik legbefolyásosabb matematikai koncepciójává váltak. Az egyszerű alapötlet ellenére rendkívül sokoldalúak, és képessé teszik a tudósokat és mérnököket arra, hogy komplex, dinamikus rendszereket modellezzenek és elemezzenek a legkülönfélébb területeken. A PageRank algoritmustól a beszédfelismerésig, a pénzügyi modellezéstől a biológiai folyamatok megértéséig, a Markov-láncok alapvető szerepet játszanak a modern technológia és tudomány számos ágában. Bár a „memóriamentesség” feltételezése néha korlátozó lehet, a kiterjesztések, mint a Rejtett Markov-modellek és a Markov Döntési Folyamatok, lehetővé teszik e korlátok áthidalását. A Markov-folyamatok tehát nem csupán egy elméleti konstrukciót képviselnek, hanem egy rendkívül praktikus és erőteljes eszköztárat biztosítanak a bizonytalansággal és időbeli dinamikával jellemezhető világunk megértéséhez és befolyásolásához.